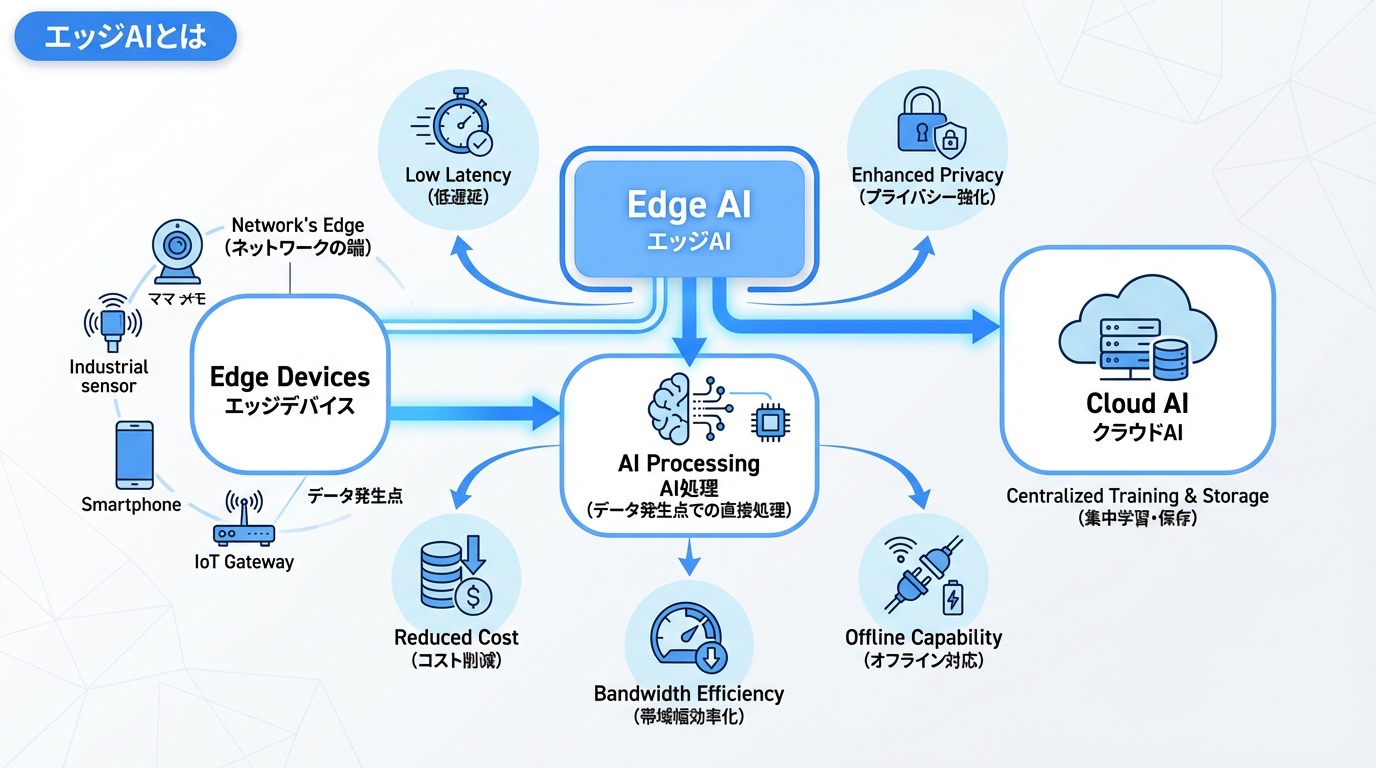

エッジAI(Edge AI)とは、クラウドではなくデバイス側でAI処理を行う技術です。低遅延・プライバシー保護・オフライン動作などのメリットがあり、スマートフォン、自動運転、IoT、製造業など幅広い分野で活用されています。本記事ではエッジAIの仕組み、クラウドAIとの違い、主要チップ、活用事例を徹底解説します。

エッジAIとは

エッジAI(Edge AI)とは、データが発生する現場(エッジ)でAI推論処理を行う技術・アーキテクチャです。従来のクラウドAIがデータをサーバーに送信して処理するのに対し、エッジAIはスマートフォン、カメラ、センサーなどのデバイス上で直接AI処理を実行します。

エッジとは何か

「エッジ」はネットワークの末端、つまりデータが発生する現場を指します。工場の製造ライン、店舗の監視カメラ、車載コンピューター、スマートフォンなど、クラウドから見て「周縁部(edge)」に位置するデバイスがエッジです。

なぜエッジAIが必要なのか

クラウドAIには以下のような課題があり、これを解決するためにエッジAIが発展しています。

- 遅延(レイテンシー):クラウドとの通信に数十〜数百ミリ秒かかる

- プライバシー:顔画像や個人情報をクラウドに送信することへの懸念

- 通信コスト:大量のデータをクラウドに送信する通信費用

- オフライン問題:ネットワーク接続がないと機能しない

- 帯域幅制限:高解像度映像などの大容量データの転送が困難

エッジAI vs クラウドAI

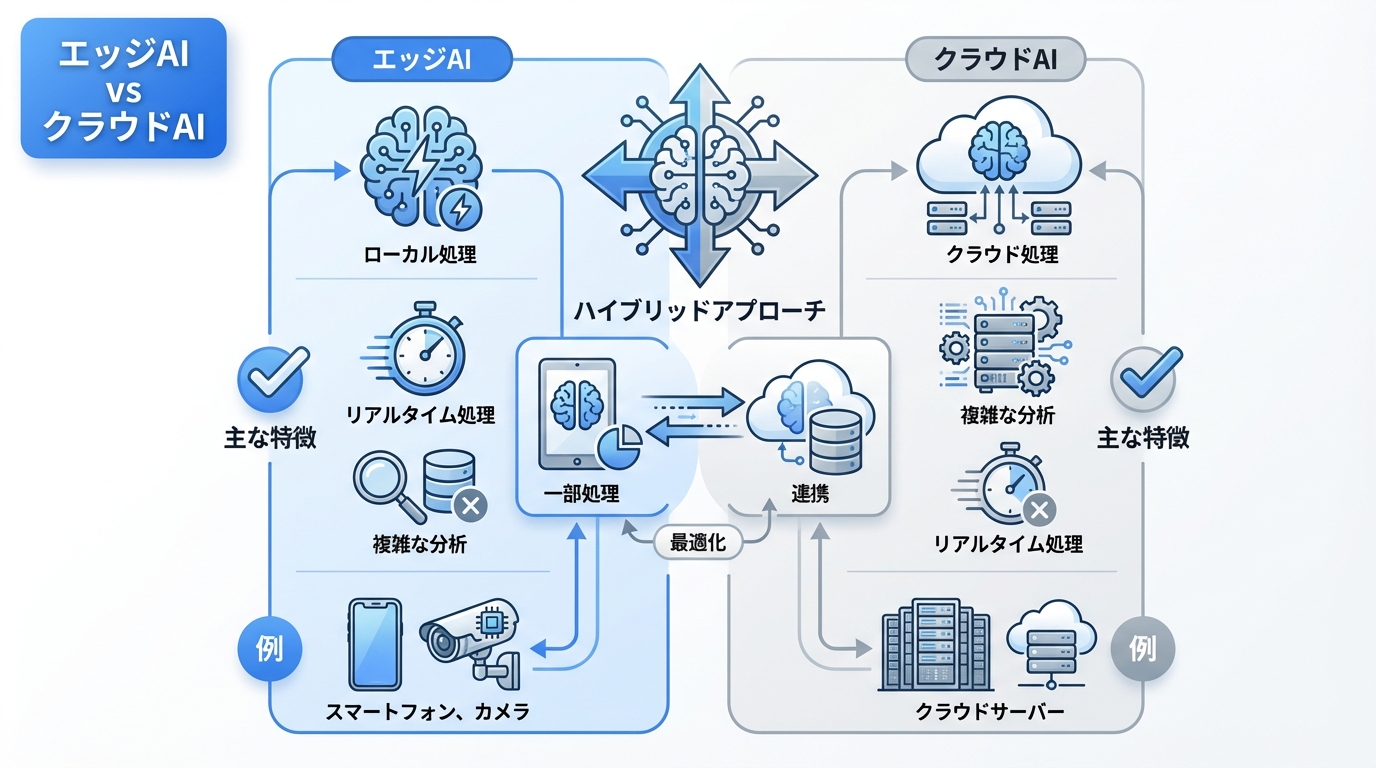

エッジAIとクラウドAIの違いを詳しく比較します。

処理場所の違い

- クラウドAI:データをクラウドサーバー(AWS、Google Cloud、Azure等)に送信し、サーバー上で推論処理

- エッジAI:デバイス上(スマートフォン、カメラ、車載コンピューター等)で推論処理

比較表

| 項目 | エッジAI | クラウドAI |

|---|---|---|

| 処理場所 | デバイス側 | クラウドサーバー |

| 遅延 | ◎ 1〜10ms | △ 50〜200ms |

| プライバシー | ◎ データが外部に出ない | △ データ送信が必要 |

| オフライン動作 | ◎ 可能 | × 不可 |

| 通信コスト | ◎ 低い | △ 高い(大容量データの場合) |

| 計算能力 | △ 限定的 | ◎ 無制限にスケール可能 |

| モデルサイズ | △ 小〜中規模 | ◎ 大規模モデルも可能 |

| 更新・管理 | △ デバイスごとに必要 | ◎ 一元管理 |

| 初期コスト | △ 高い(専用チップ等) | ◎ 低い(従量課金) |

ハイブリッドアプローチ

実際には、エッジAIとクラウドAIを組み合わせた「ハイブリッドアプローチ」が主流です。リアルタイム性が求められる処理はエッジで、複雑な分析や学習はクラウドで行う構成が一般的です。

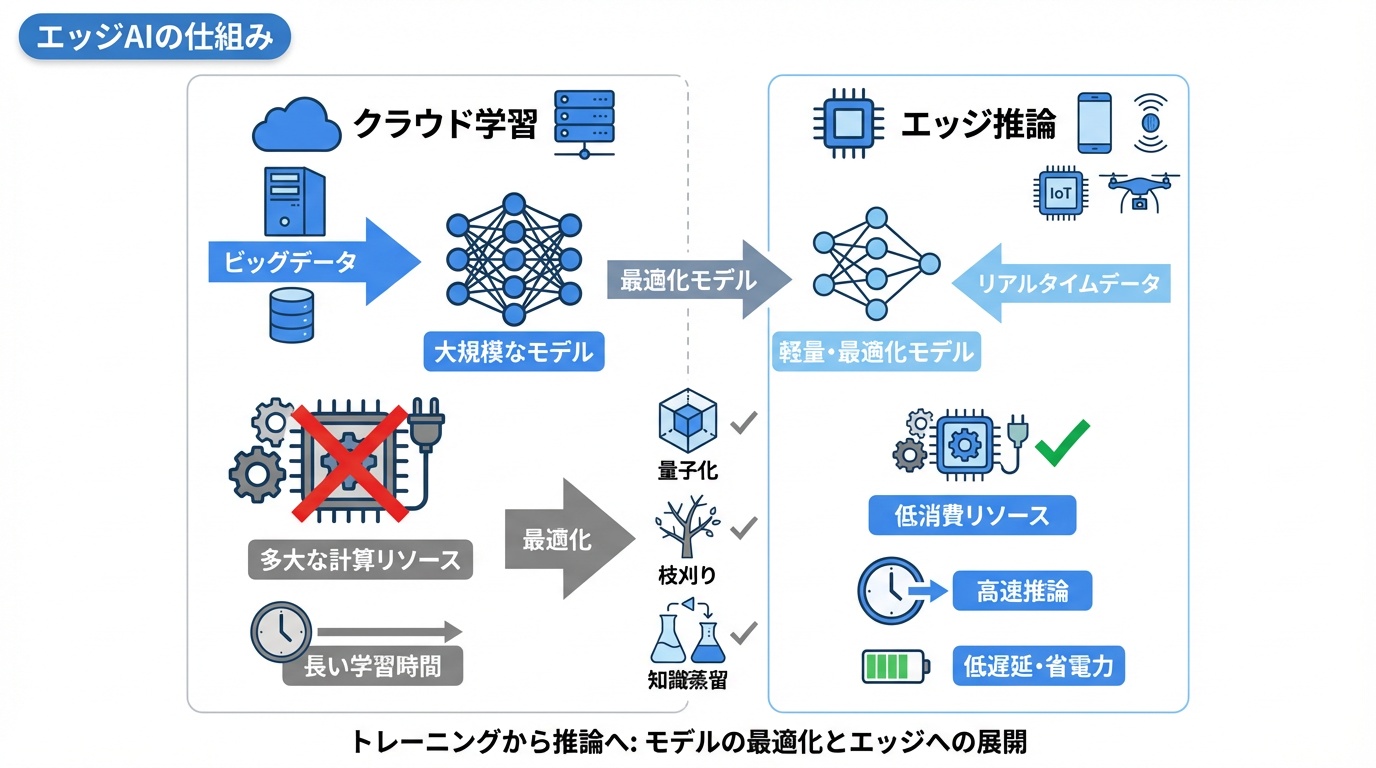

エッジAIの仕組み

エッジAIがどのように動作するのか、技術的な仕組みを解説します。

推論と学習の分離

AIには「学習(トレーニング)」と「推論(インファレンス)」の2つのフェーズがあります。

- 学習:大量のデータからモデルを作成。膨大な計算リソースが必要

- 推論:学習済みモデルを使って予測を行う。比較的軽量

エッジAIは主に「推論」をエッジで行い、「学習」はクラウドで行うことが一般的です。

モデルの軽量化技術

エッジデバイスの限られた計算リソースでAIを動作させるため、以下の軽量化技術が使われます。

- 量子化(Quantization):32ビット浮動小数点を8ビット整数に変換し、計算量を削減

- プルーニング(Pruning):不要なニューロン接続を削除してモデルをスリム化

- 知識蒸留(Knowledge Distillation):大きなモデルの「知識」を小さなモデルに転移

- アーキテクチャ設計:MobileNet、EfficientNetなどエッジ向けに設計されたモデル

エッジAIチップ

エッジAI専用に設計された半導体チップ(NPU、AIアクセラレータ)が搭載されています。

- Apple Neural Engine:iPhone、Mac搭載。毎秒35兆回の演算

- Qualcomm Hexagon NPU:Android端末搭載

- Google Edge TPU:Coral開発ボード、Pixelスマートフォン

- Intel NPU:Core Ultraプロセッサ搭載PC

- NVIDIA Jetson:産業用エッジAIプラットフォーム

エッジAIの主要チップ比較

エッジAI向け主要チップを比較します。

| チップ | メーカー | 用途 | 性能 | 特徴 |

|---|---|---|---|---|

| Neural Engine | Apple | iPhone/Mac | 35 TOPS | iOS/macOS統合 |

| Hexagon NPU | Qualcomm | Android | 45 TOPS | Android端末で最多 |

| Edge TPU | IoT/組込 | 4 TOPS | TensorFlow Lite最適化 | |

| Jetson Orin | NVIDIA | 産業用 | 275 TOPS | ロボット・自動運転 |

| Core Ultra NPU | Intel | PC | 34 TOPS | AI PC向け |

| Hailo-8 | Hailo | 汎用 | 26 TOPS | 低消費電力 |

※ TOPS = Tera Operations Per Second(1秒あたり1兆回の演算)

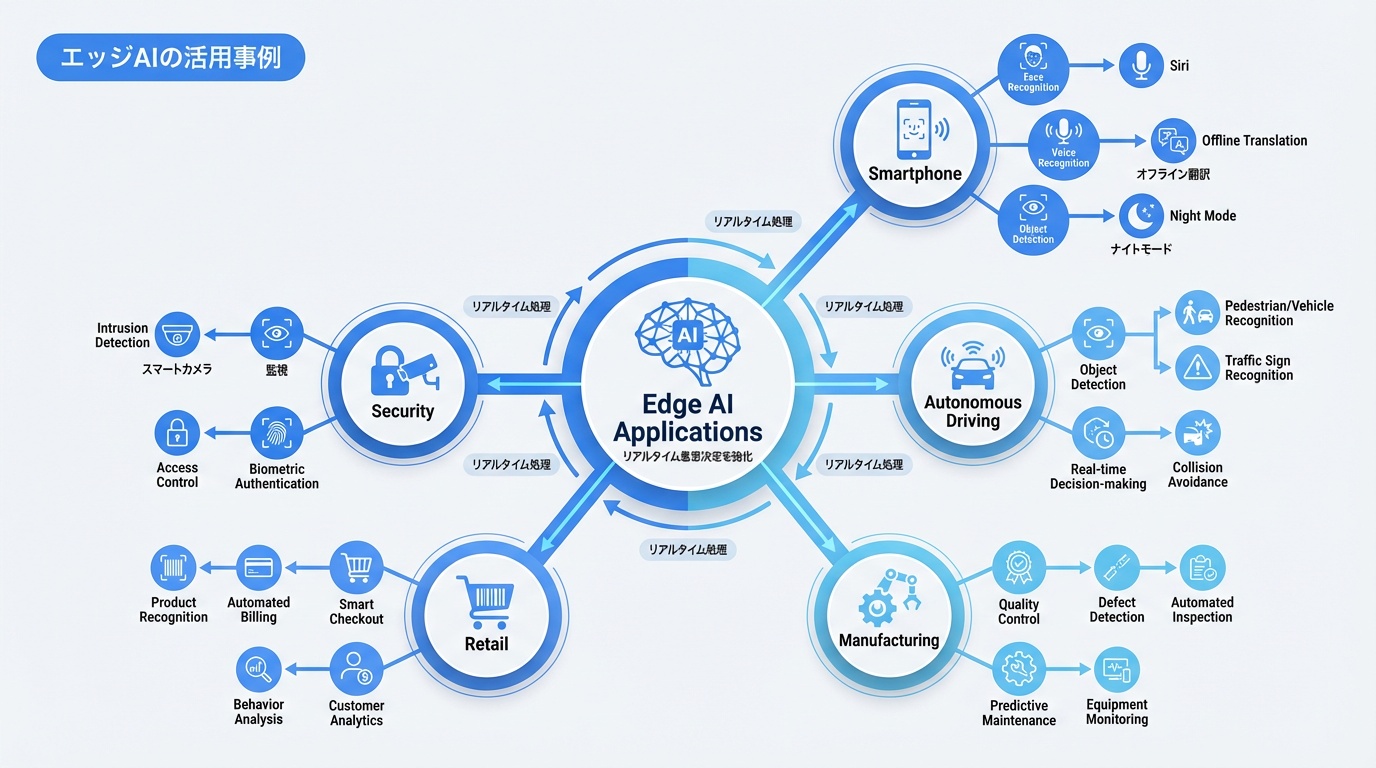

エッジAIの活用事例

エッジAIが実際に活用されている分野を紹介します。

スマートフォン

最も身近なエッジAI活用例です。

- 顔認証:Face ID(Apple)、顔認証ロック(Android)

- カメラ機能:夜景モード、ポートレートモード、被写体認識

- 音声認識:オフライン音声入力、Siri/Googleアシスタントの一部処理

- 翻訳:オフライン翻訳、リアルタイム字幕

自動運転

自動運転車はエッジAIの代表的な応用分野です。

- 物体認識:歩行者、車両、信号、標識の検出

- 経路予測:他車両・歩行者の動きを予測

- 判断・制御:ステアリング、アクセル、ブレーキの制御

クラウドに頼れない(遅延が許容できない)ため、車載コンピューター(NVIDIA DRIVE、Teslaの自社チップ等)でAI処理を行います。

製造業・工場

スマートファクトリーでエッジAIが活用されています。

- 外観検査:製品の傷・欠陥をリアルタイム検出

- 予知保全:設備の異常を事前に検知

- 品質管理:製造プロセスの最適化

小売・店舗

- 無人店舗:Amazon Goのような自動決済システム

- 在庫管理:棚の画像認識による在庫把握

- 顧客分析:来店者の属性・動線分析(プライバシー配慮)

監視・セキュリティ

- 異常検知:不審者・不審行動の検出

- 顔認識:入退室管理、本人確認

- 車両認識:ナンバープレート認識、駐車場管理

医療・ヘルスケア

- ウェアラブル:Apple Watchの心電図、転倒検知

- 画像診断:X線・CT画像の即時分析

- 患者モニタリング:バイタルサインの異常検知

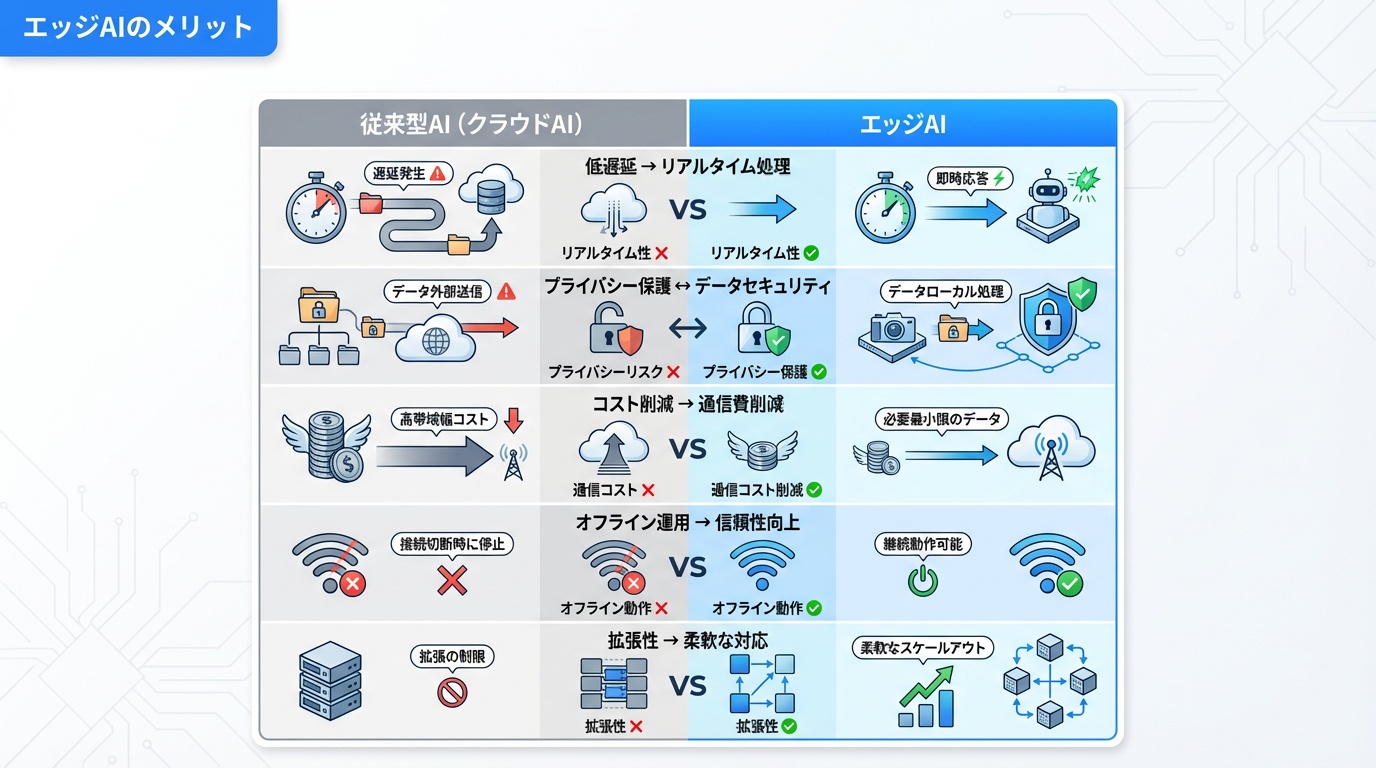

エッジAIのメリット

エッジAIを導入するメリットを詳しく解説します。

低遅延(リアルタイム処理)

クラウドとの通信が不要なため、ミリ秒単位の応答が可能です。自動運転やロボット制御など、遅延が許されない用途に必須です。

プライバシー保護

顔画像や音声データがデバイス外に出ないため、プライバシーリスクを大幅に低減できます。GDPR等のデータ保護規制への対応も容易になります。

通信コスト削減

高解像度映像などの大容量データをクラウドに送信する必要がなくなり、通信コストを削減できます。特にIoTデバイスが大量に存在する環境で効果的です。

オフライン動作

ネットワーク接続がない環境でもAI機能が動作します。工場、地下、僻地、航空機内など、通信が不安定な環境で重要です。

スケーラビリティ

処理をエッジに分散することで、クラウドの負荷を軽減し、システム全体のスケーラビリティが向上します。

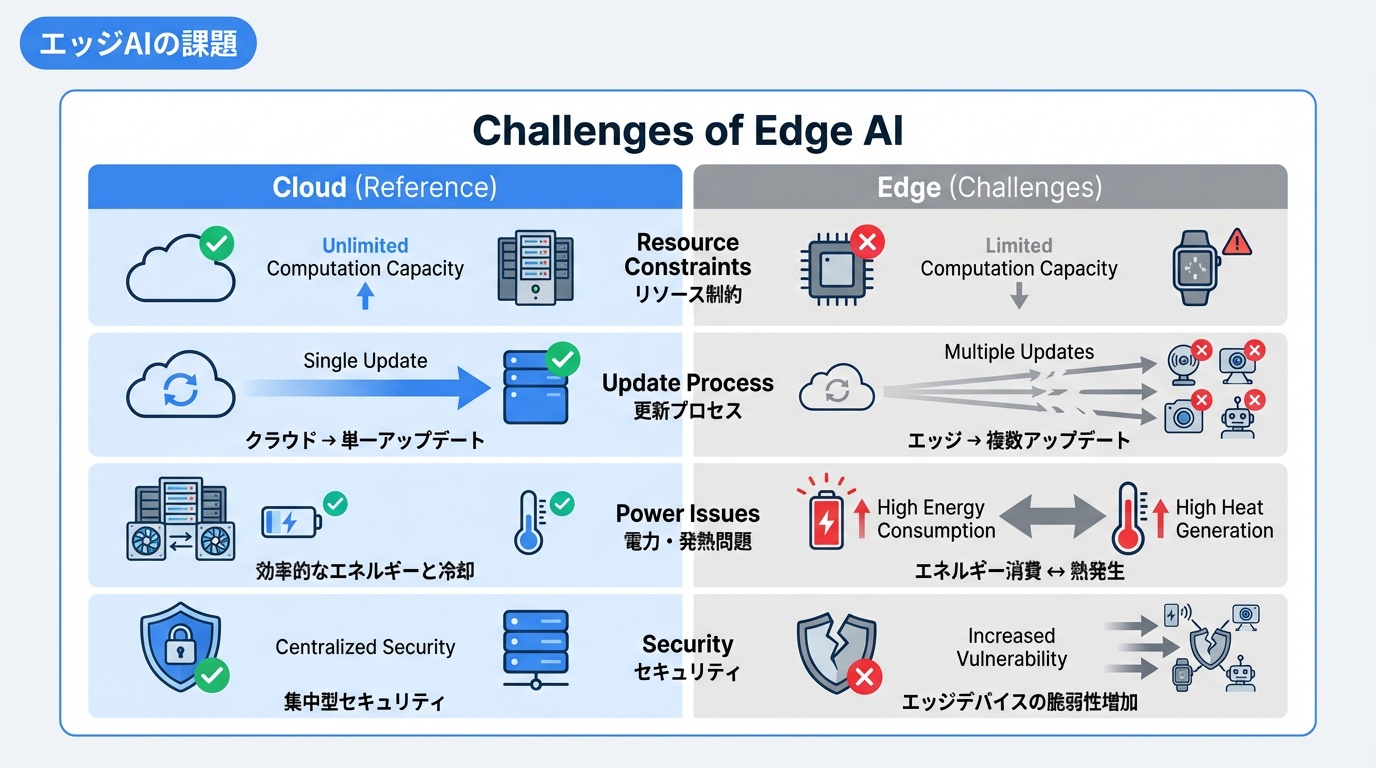

エッジAIの課題

エッジAI導入時の課題を解説します。

計算リソースの制約

エッジデバイスはクラウドサーバーと比較して計算能力が限られます。大規模モデル(GPT-4など)はエッジでは動作できません。

モデル更新の手間

クラウドなら一箇所でモデルを更新できますが、エッジでは各デバイスにモデルを配信する必要があります。OTA(Over-The-Air)更新の仕組みが必要です。

電力・発熱

バッテリー駆動のデバイスでは消費電力が制約になります。AI処理は電力を消費するため、バッテリー寿命とのトレードオフがあります。

セキュリティ

エッジデバイスは物理的にアクセス可能なため、モデルの盗難やリバースエンジニアリングのリスクがあります。

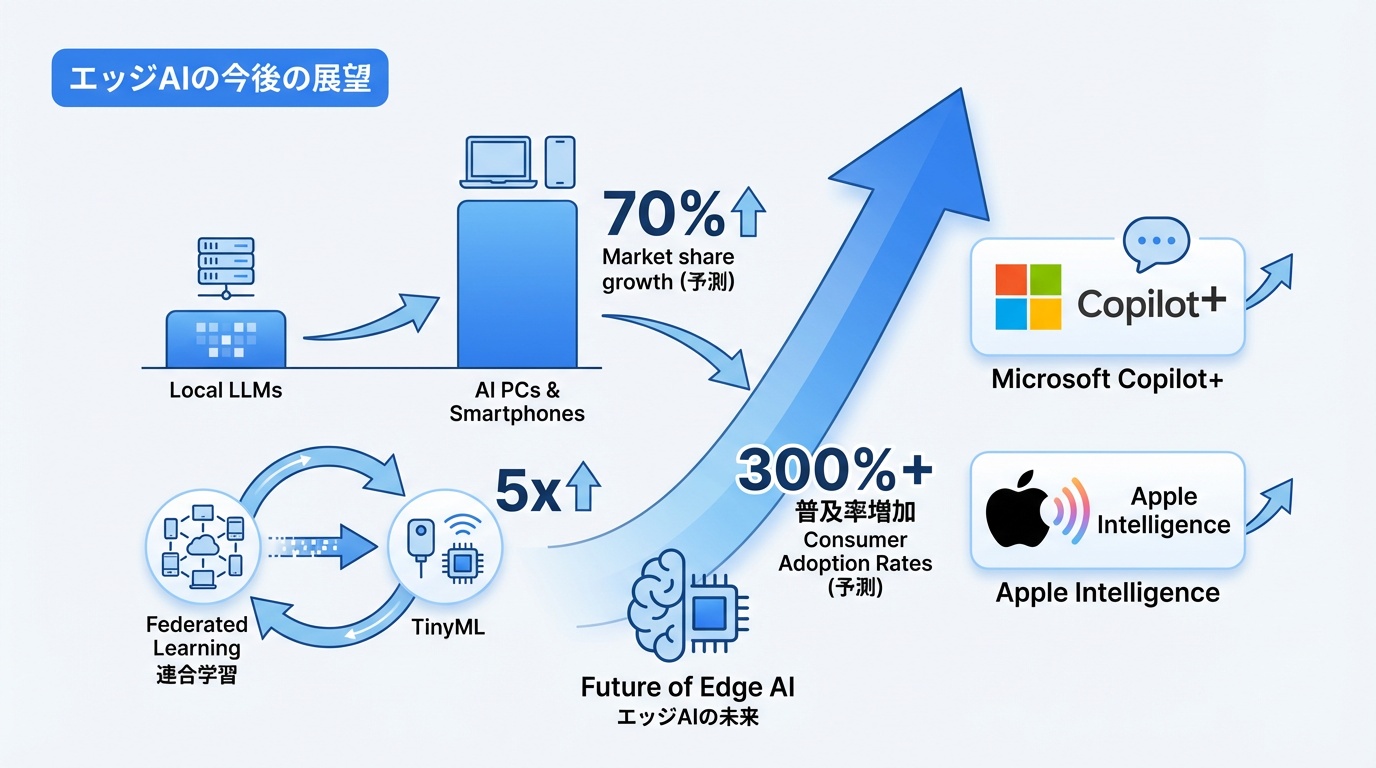

エッジAIの今後の展望

エッジAIの将来動向を予測します。

ローカルLLMの普及

Llama、Phi、Gemma Nanoなど、スマートフォンやPCで動作する軽量LLMが登場しています。プライバシーを保護しながら、ChatGPTのようなAIアシスタントをローカルで動作させることが可能になりつつあります。

AI PC・AIスマートフォン

NPU搭載のAI PCやAIスマートフォンが普及し、エッジAIが一般消費者向けにも広がっています。Microsoft Copilot+ PC、Apple Intelligenceなどがこの流れを加速しています。

フェデレーテッドラーニング

エッジデバイスで学習を行い、モデルの更新情報のみをクラウドで集約する「フェデレーテッドラーニング」が研究されています。プライバシーを保護しながら、分散的にモデルを改善できます。

TinyML

マイコンレベルの超小型デバイスでAIを動作させる「TinyML」も発展しています。センサーや家電など、あらゆるデバイスにAIが搭載される未来が近づいています。

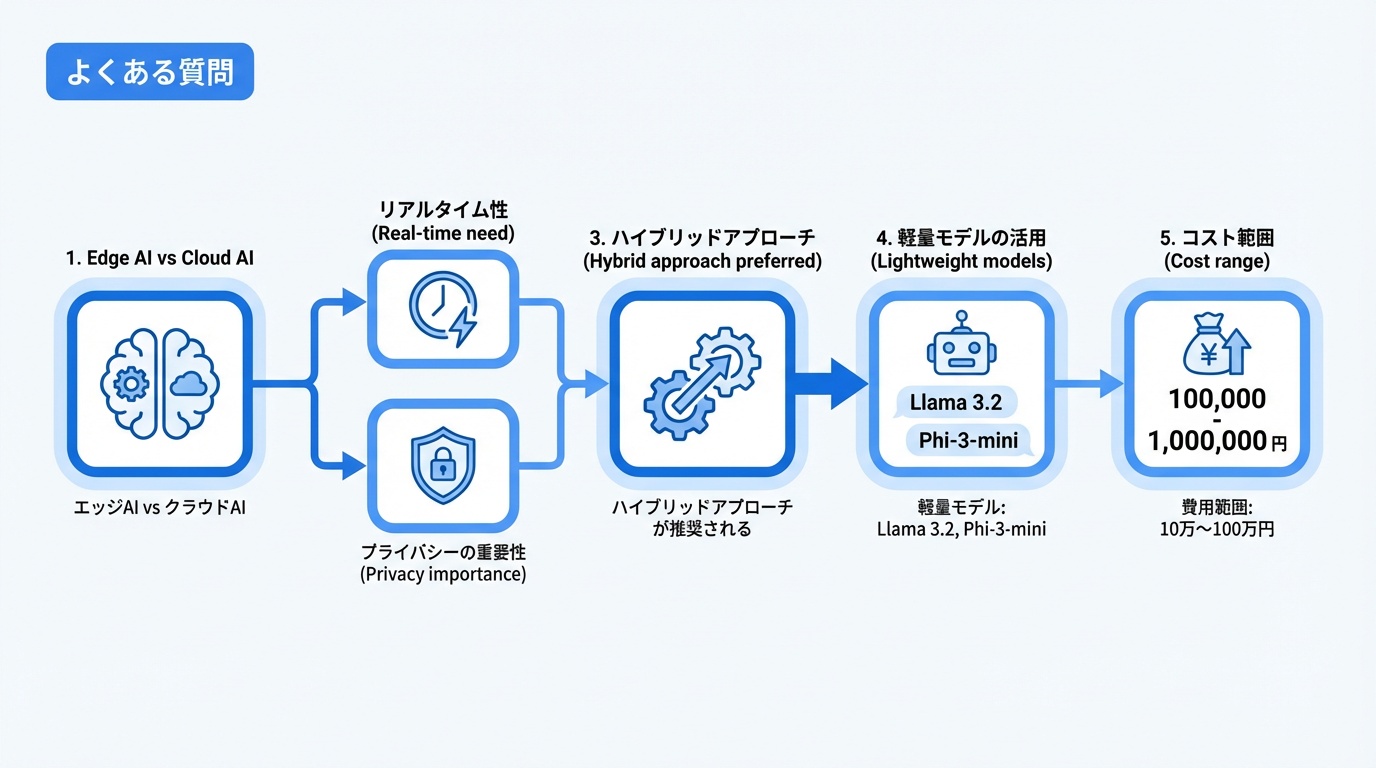

よくある質問

Q. エッジAIとクラウドAI、どちらを選ぶべきですか?

用途によります。リアルタイム性・プライバシーが重要ならエッジAI、大規模な計算や一元管理が必要ならクラウドAI。多くの場合、両者を組み合わせたハイブリッドアプローチが最適です。

Q. エッジAIでChatGPTは動きますか?

GPT-4のような大規模モデルは不可能ですが、Llama 3.2(3B)やPhi-3-miniなどの軽量モデルはスマートフォンで動作します。機能は限定的ですが、オフラインでのAIアシスタントが実現可能です。

Q. エッジAIの導入コストは?

用途によりますが、産業用途では数十万〜数百万円程度が一般的です。NVIDIA Jetsonは数万円から、Raspberry Pi + Coral Edge TPUなら1万円程度で始められます。

Q. エッジAIの開発には何が必要ですか?

TensorFlow Lite、PyTorch Mobile、Core ML(Apple)、ONNX Runtimeなどのフレームワークを使用します。モデルの軽量化と、ターゲットデバイスへの最適化が主な作業です。

Q. 5G/6GでエッジAIは不要になりますか?

通信速度が向上しても、エッジAIの価値は残ります。プライバシー保護、オフライン動作、通信コスト削減などは通信速度だけでは解決できない課題です。むしろ5G/6Gとエッジの組み合わせで新たな用途が生まれています。

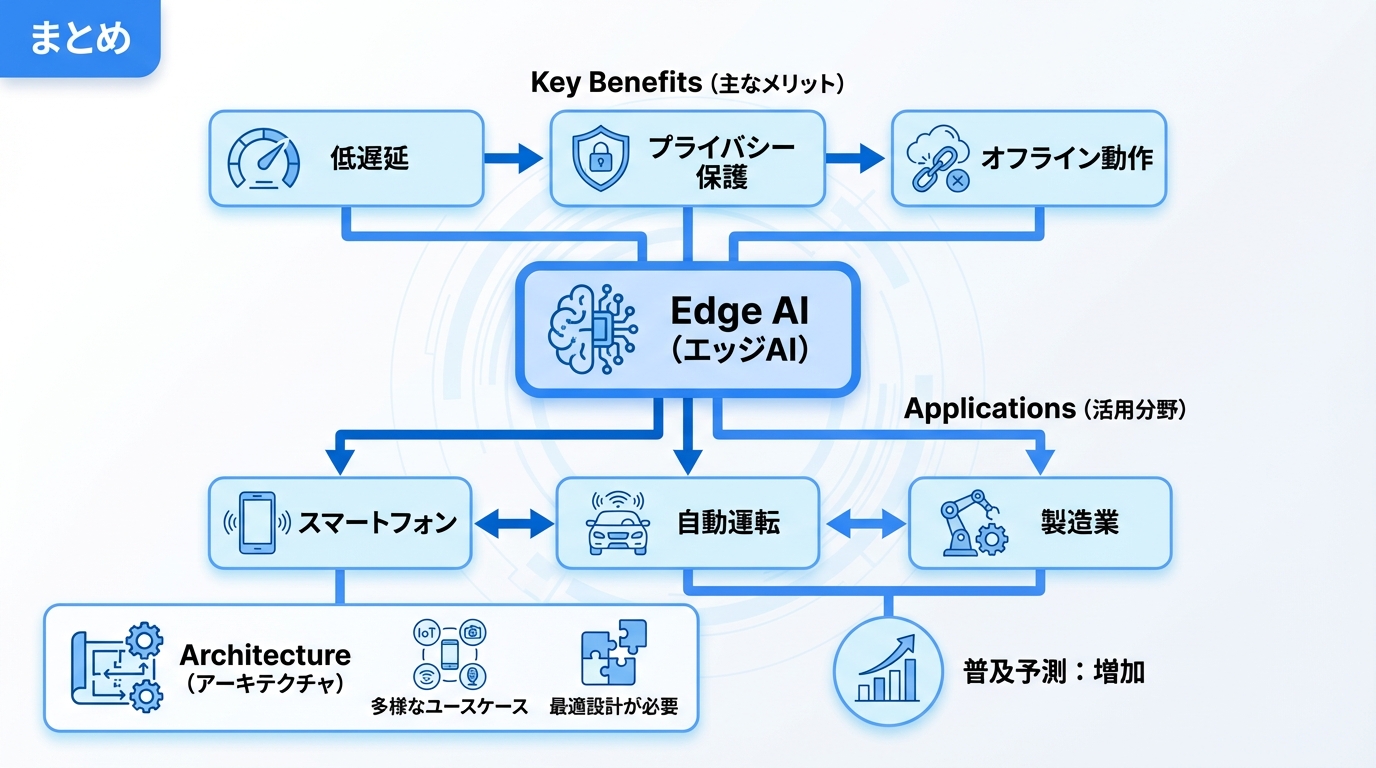

まとめ

エッジAIは、低遅延・プライバシー保護・オフライン動作を実現する重要な技術です。スマートフォン、自動運転、製造業など幅広い分野で活用されており、今後さらに普及が進むと予測されます。

クラウドAIとの使い分け・組み合わせが重要であり、用途に応じた最適なアーキテクチャ設計が求められます。AI PCやローカルLLMの普及により、エッジAIは一般消費者にも身近な技術になりつつあります。

https://ainow.jp/ai-semiconductor-guide/

https://ainow.jp/physical-ai/

OpenAI

OpenAI Google

Google ChatGPT

ChatGPT Bard

Bard Stable Diffusion

Stable Diffusion Midjourney

Midjourney